目录

项目概述

云脑具身智能Agent系统是一套本人从0到1独立设计并开发的通用具身智能框架,旨在让机器人通过自然语言理解与执行复杂的长时程任务。该系统已成功应用于多个工业级场景,包括:

- 云深处科技微信视频号及世界人工智能大会:实现自然语言交互与指令执行,展示机器人智能决策能力

- 快递配送场景:解决最后一公里配送中的网络时延与中断问题

- 园区智能巡检:集成MCP的新一代语义级导航系统

本项目是LLM Agent技术在工业机器人领域的重要实践,验证了大语言模型在复杂物理环境中的决策能力。

👨💻 角色

核心开发者 与 系统架构师

负责整体架构设计、算法开发、系统实现与工业部署。

❓ 背景与问题

传统机器人系统面临以下挑战:

- 交互门槛高:需要编程能力才能控制机器人,普通用户难以使用

- 任务执行僵化:只能执行预定义的固定流程,无法应对动态变化

- 错误恢复能力弱:遇到意外情况(如障碍物)无法自主判断和调整

- 网络依赖性强:在高时延或弱网环境下系统稳定性差

- 环境理解不足:缺乏对空间语义的理解,无法执行”去办公室”等抽象指令

🎯 目标

- 构建一套通用的具身智能Agent框架,支持自然语言控制机器人

- 实现复杂长时程任务的自主规划与执行

- 设计鲁棒的错误恢复机制,提升系统在真实环境中的可靠性

- 验证系统在多种工业场景下的泛化能力

- 探索LLM Agent在网络受限环境下的部署方案

✨ 解决方案

阶段一:云深处合作 - 云脑Agent从0到1

时间:2024年3月 - 2024年9月

合作方:云深处科技、之江实验室

核心架构设计

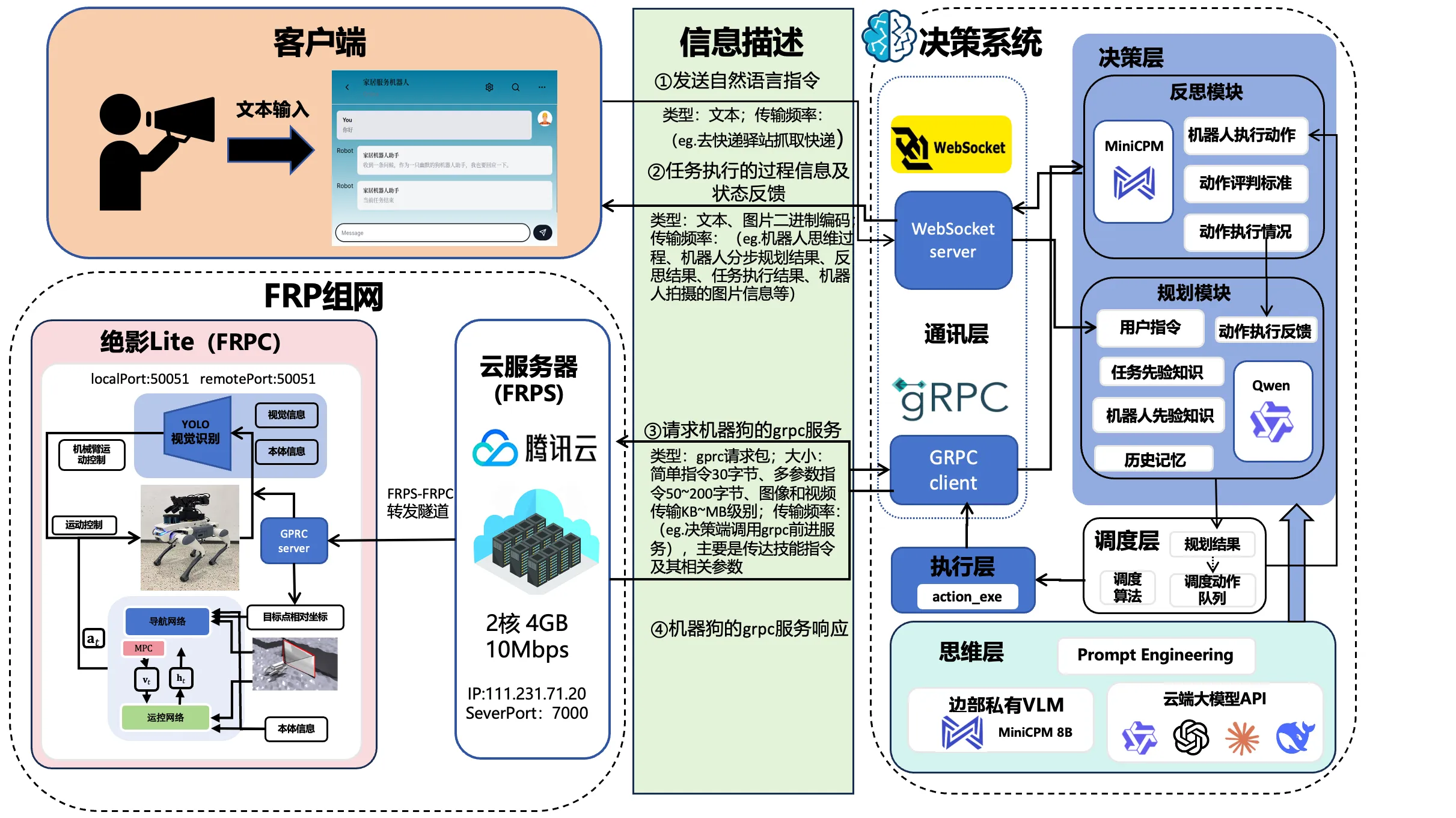

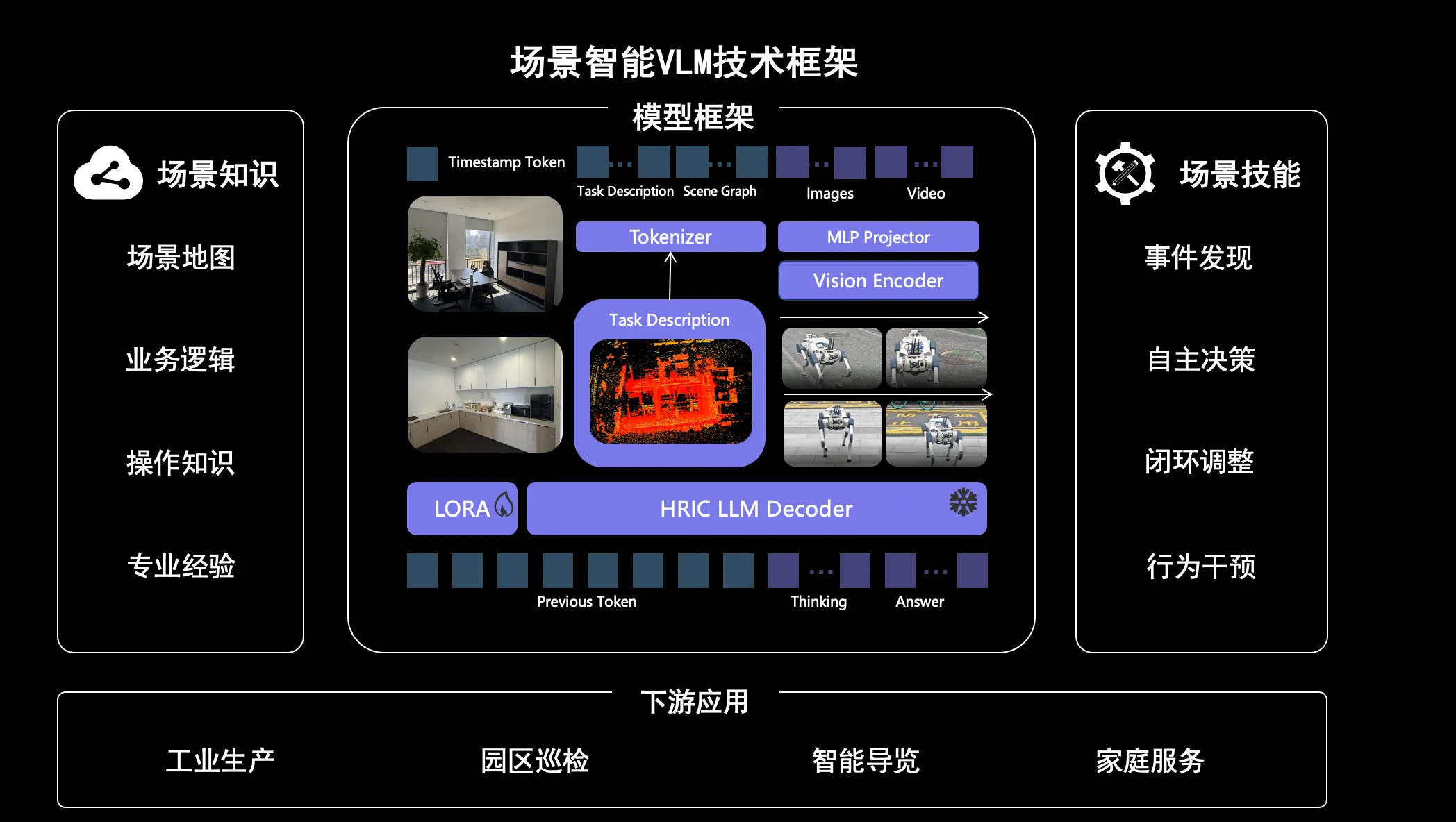

云脑核心架构如图所示:

设计了Planner-Scheduler-Executor三层解耦架构:

-

Planner(规划层):基于CoT(Chain-of-Thought)的任务拆解

- 将自然语言指令(如”去巡检19号楼附近的1号点位并拍照”)分解为子任务序列

- 利用LLM的推理能力进行多步规划

-

Scheduler(调度层):逻辑调度与流程控制

- 管理任务执行顺序

- 处理任务依赖关系

- 监控执行状态

-

Executor(执行层):动作映射与底层控制

- 将抽象任务转化为机器人控制指令

- 与硬件层交互(导航、视觉、语音等)

关键技术创新

- 自定义工具协议:在MCP协议诞生前,独立设计了类似的任务-动作映射协议

- 反思框架:实现”执行-观察-反思”闭环,支持错误自我修正

- 思维链优化:通过精心设计的Prompt模板,利用CoT提升多步逻辑推理准确率

项目成果

- 成功部署于云深处机器狗,实现自然语言控制

- 系统在云深处科技微信视频号展示,获得业界关注

阶段二:快递配送Agent与网络评估

时间:2024年8月 - 至今 合作方:华为 & 云深处

项目展示

问题定义

快递”最后一公里”配送场景中的特殊挑战:

- 无地图导航:场景动态变化,无法完全用SLAM导航

- 网络高时延:云端LLM推理存在延迟(200-500ms)

- 弱网环境:部分区域信号覆盖差,任务易中断

解决方案

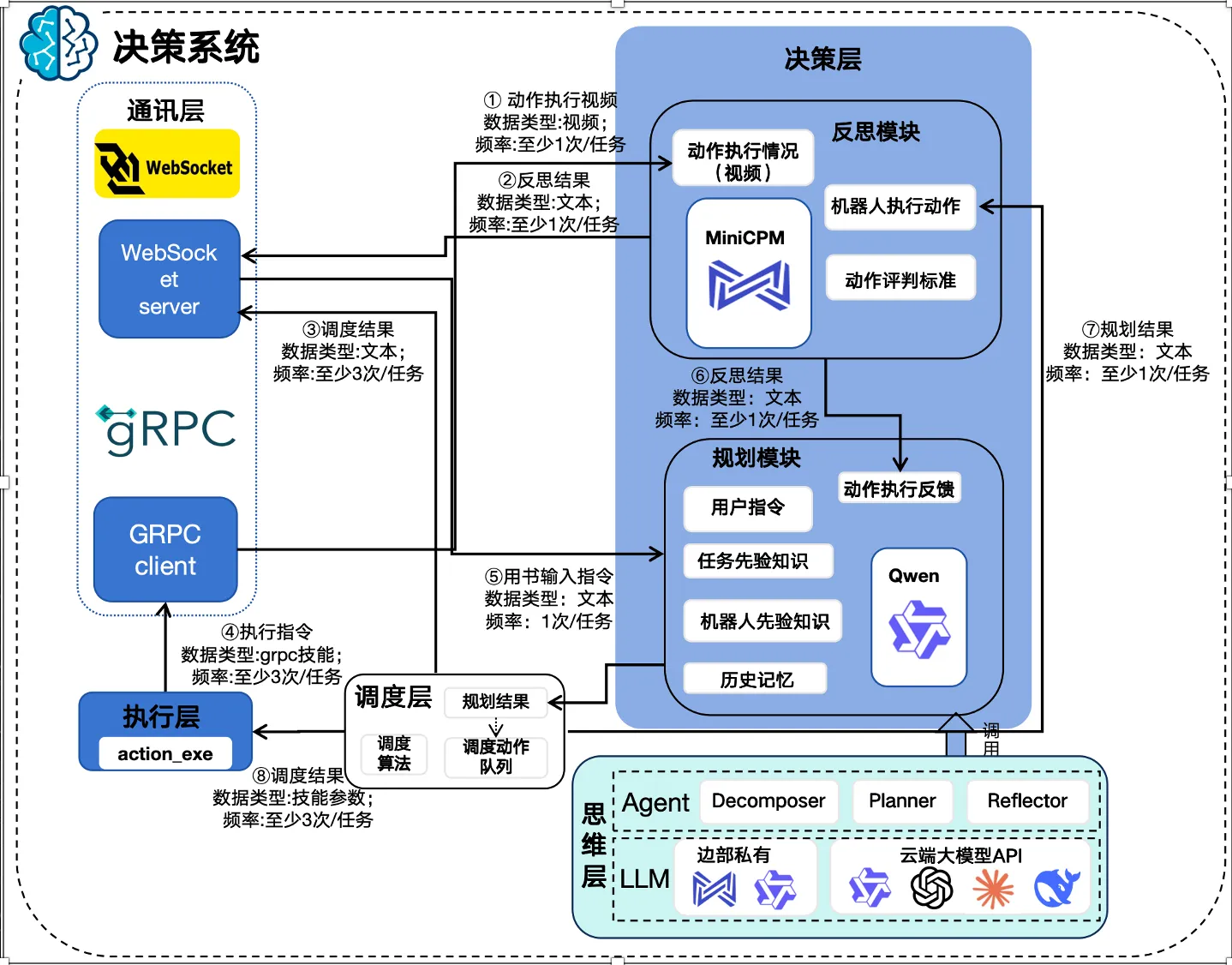

1. 模块化架构优化

- 进一步优化三层架构的模块边界

- 设计轻量级本地决策模块,采取“大小脑”结合的方式,减少云端依赖

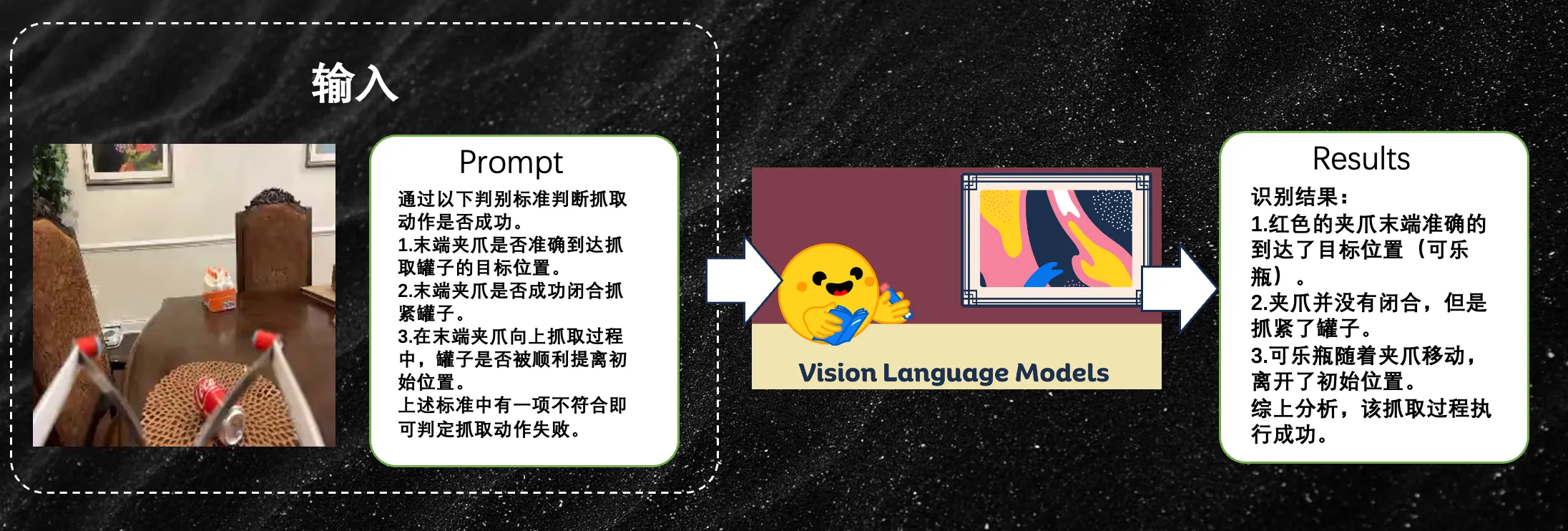

2. 错误恢复

- 当执行失败时,Agent能自主分析原因并重新规划

- 示例:抓取快递失败 → VLM“小脑”反思错误原因 → 规划新的抓取位置

3. 无地图导航

- 结合Prompt工程和RAG框架,探索SLAM无法实现的动态场景导航方法

4. 网络评估框架

- 系统部署于云端服务器

- 进行充分的网络时延测试(不同网络环境下的性能评估)

- 信号强度与任务成功率关联分析

项目意义

为具身智能在复杂网络环境下的落地提供了重要参考数据和技术方案。

阶段三:海创智能巡检Agent系统

时间:2025年8月 - 至今

公司:海创人形机器人创新中心

系统架构升级

基于前期经验,进行新一代架构升级:

1. 标准化工具层(MCP协议)

- 引入Model Context Protocol (MCP) 重构底层执行模块

- 实现语音识别、导航、视觉检测等工具的标准化接口

- 提升工具扩展性和模型调用稳定性

2. 空间记忆对齐

- 问题:固定路线巡检更改需要编程能力,环境信息(SLAM地图/语义点位)关联不足

- 解决方案:

- 设计空间语义映射模块

- 将自主探索构建的SLAM地图关键信息转化为LLM可理解的文本描述

- 结合人类偏好数据存储(如”办公室在二楼东侧”)

- 利用RAG技术实现”语义级”导航

3. 异步反思机制

- 结合Prompt Engineering与异步线程技术

- 构建”执行-观察-反思”闭环

- 机器狗在巡检中能实时识别异常并报警,同时不阻塞主线程任务

部署成果

- 成功部署于四足机器狗

- 实现从自然语言指令到复杂巡检动作的端到端自动化

- 在杭州火车西站展出演示

🏗️ 技术架构

整体架构图

关键技术栈

- LLM:Qwen / Claude / 国产大模型

- 框架:LangChain、FastAPI

- 协议:MCP (Model Context Protocol)、WebSocket、GRPC

- 技术:CoT、RAG、ReAct、Prompt Engineering

- 机器人:ROS、SLAM、导航算法

⚙️ 挑战

1. LLM推理稳定性

挑战:大语言模型输出不稳定,可能产生幻觉或格式错误

解决:

- 设计严格的输出格式约束(JSON Schema)

- 多轮验证与错误重试机制

- 思维链引导,提升推理准确性

2. 网络时延与鲁棒性

挑战:云端LLM推理存在时延,弱网环境下系统可用性差

解决:

- 本地缓存高频任务的推理结果

- 设计轻量级本地决策模块(规则引擎)

- 异步任务处理,避免阻塞主线程

3. 空间语义理解

挑战:LLM难以直接理解SLAM地图的几何信息

解决:

- 设计语义映射模块,将坐标转化为文本描述

- 利用RAG技术检索历史语义信息

- 结合人类标注的偏好数据

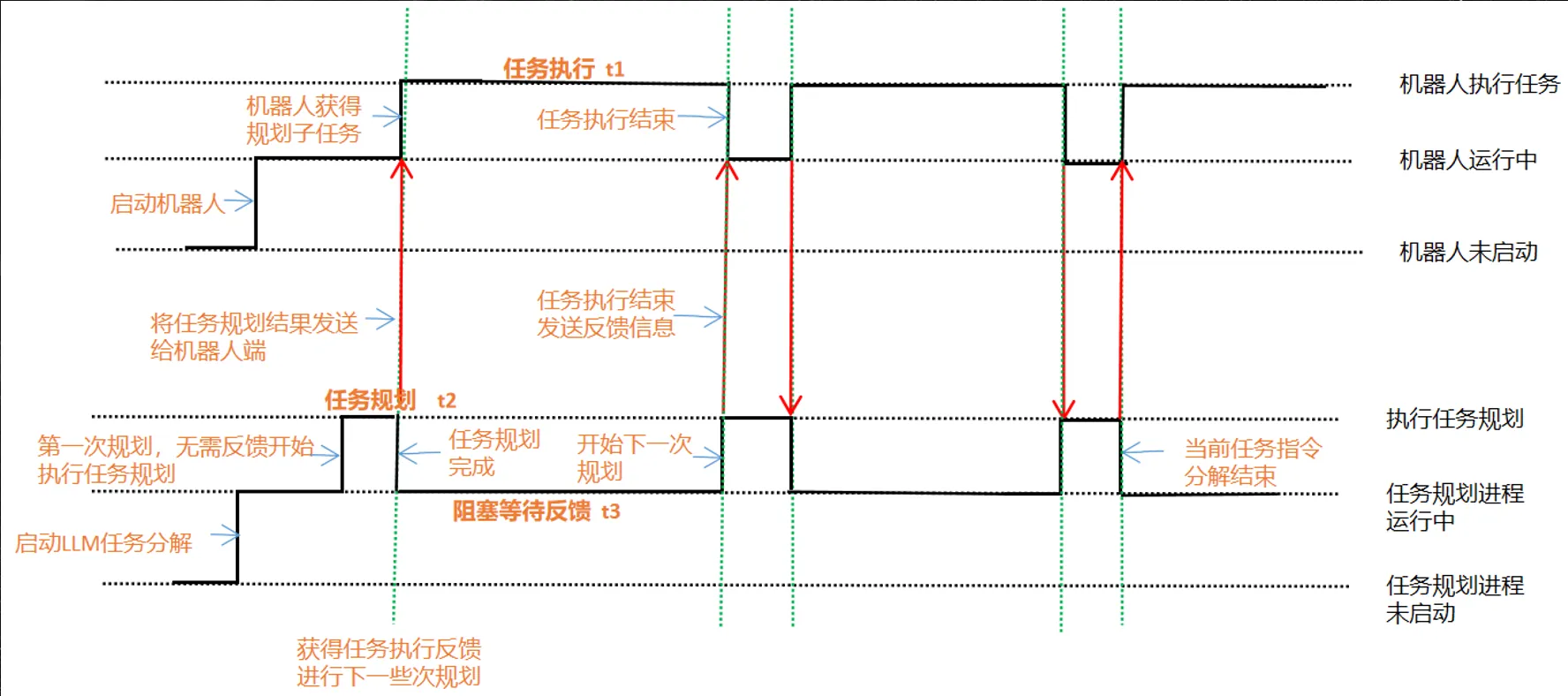

4. 长时程任务规划

挑战:多步复合任务中,中间步骤失败导致整体失败

解决:

- 每个子任务独立的成功/失败处理逻辑

- 反思机制:失败后分析原因并重新规划

✨ 总结与展望

项目成果

-

技术创新:

- 独立设计了通用的具身智能Agent架构

- 在MCP协议诞生前实现了类似的工具调用标准化

- 创新性地将RAG技术应用于空间语义理解

-

工业落地:

- 成功应用于4个不同的工业场景

- 系统在世界人工智能大会、杭州火车西站等公共场合展出

- 验证了LLM Agent在真实物理环境中的可行性

-

学术贡献:

- 相关研究形成IROS 2025论文(Best Paper Award Finalist)

- 为具身智能领域提供了实践经验和技术参考

未来展望

- 多模态融合:整合视觉、触觉等多模态感知,提升环境理解能力

- 边缘计算:探索轻量级LLM在边缘设备上的部署,降低网络依赖

- 人机协作:设计更自然的人机交互方式,提升用户体验

- 泛化能力:扩展到更多类型的机器人平台和应用场景

项目意义:云脑Agent系统不仅是技术创新,更是对”机器人如何真正服务人类”这一问题的探索。通过自然语言交互,我们让机器人从”工具”变成了”助手”,这是具身智能走向普及的重要一步。